Mei 2024 was natuurlijk allereerst de maand van Joost ‘Europapa’ Klein, van Dick ‘AIVD’ Schoof (en dus niet van Ronald ‘patent’ Plasterk), en van een veroordeelde Donald T., maar er was nog wel meer groot nieuws dat ons allen bezighield. Van de luchtaanvallen in Rafah tot een instortende parkeergarage in Nieuwegein, en van massale studentenprotesten tot een verhit filmfestival in Cannes, en van een stoppende Youp van ‘t Hek tot een nieuwe Billie Eilish. Om maar wat te noemen. Maar wat gebeurde er allemaal dat voor de recruiters van Nederland van belang is? Een overzicht, in 7 delen.

#1. Toch nog gelijke kansen-initiatief

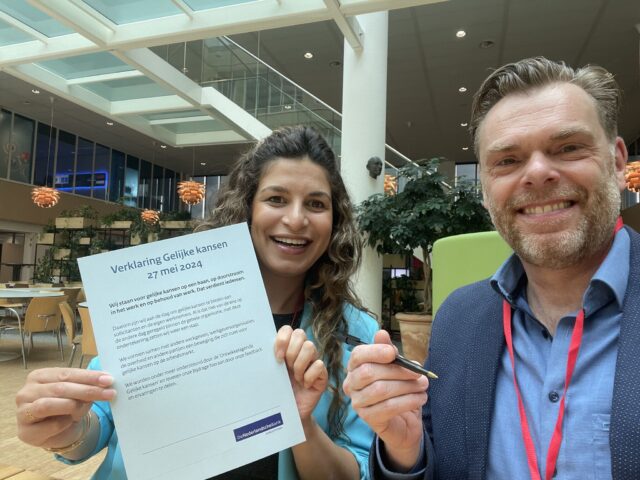

Dacht je soms dat recruiters geen politieke invloed hadden? Think again. Nadat in de Eerste Kamer het wetsvoorstel Toezicht Gelijke Kansen bij Werving en Selectie sneuvelde, startte een grote groep recruiters het platform Recruiters voor Rechtvaardigheid. En mét resultaat: een groep van ruim 50 bedrijven en organisaties tekende 27 mei de verklaring ‘Gelijke Kansen’, op initiatief van SZW-minister Karien van Gennip, waarmee ze aangaven zich tóch te scharen achter een beweging die toewerkt naar een inclusievere arbeidsmarkt.

Van Gennip bleek blij met de verklaring. ‘Iedereen verdient een gelijke kans in de zoektocht naar werk of bij promoties. Echt gelijke kansen bieden door bijvoorbeeld objectief te werven en selecteren vraagt serieuze inzet van werkgevers. Daarom is het een krachtig signaal dat een groep koplopers vandaag deze verklaring tekent. Zij vormen een inspiratiebron voor andere bedrijven en organisaties. Samen stellen we een nieuwe norm.’ Eat that, tegenstemmers in de Senaat. Bedrijven die ook met gelijke kansen aan de slag willen kunnen hierbij overigens ondersteuning krijgen vanuit de zogeheten Ontwikkelagenda van SZW.

#2. Einde sollicitatieplicht voor WW’ers?

Nog meer nieuws uit politiek Den Haag: de minister gunde in mei 2024 ook het UWV een groot experiment. De komende 4 jaar doen 100.000 WW-gerechtigden mee aan een onderzoek of de sollicitatieplicht wel werkt, of dat vrijstelling of maatwerk beter helpt. ‘Met dit experiment kunnen we toetsen wat écht werkt. Zo bieden we een basis voor effectief beleid om WW’ers weer aan het werk te helpen’, aldus Van Gennip.

De huidige sollicitatieplicht voor WW’ers is al langer onderwerp van discussie. Het kan demotiverend werken voor betrokkenen, en vergroot lang niet altijd de kansen op de arbeidsmarkt, zo wordt vaak gesteld. Het 4-jarige onderzoek dat nu is overeengekomen moet op dit soort stellingen een sluitend antwoord gaan opleveren. Er zijn 3 onderzoeksgroepen: 1 groep houdt gewoon de sollicitatieplicht, bij de andere groep vervalt die plicht, en bij de derde worden individuele maatwerkafspraken gemaakt. Bedoeling is dat het onderzoek dit najaar van start gaat.

#3. 150.000 cv’s ingezien op Werk.nl

Minder fijn nieuws voor het UWV was er deze maand ook: op 4 mei 2024 kreeg een account namelijk ‘in buitenproportionele mate‘ inzage in cv’s op werk.nl, en downloadde deze hoogstwaarschijnlijk ook. ‘Zeer kwalijk’, aldus Judith Duveen, directeur Werkbedrijf van UWV. ‘ We hebben direct passende maatregelen genomen en gaan de betrokken mensen zo goed mogelijk informeren over de gevolgen van deze onwenselijke massale inzage en mogelijke download voor vermoedelijk oneigenlijk gebruik.’ Het is de tweede keer dat UWV dit treft: in 2019 werden ook al eens 117.000 cv’s gedownload, vermoedelijk voor ‘de verkeerde doeleinden’.

#4. Discriminatie nog altijd vooral op leeftijd

Wat is de meest voorkomende vorm van discriminatie in Nederland? Dat blijkt nog altijd discriminatie op basis van leeftijd te zijn, aldus het jaarlijkse Talent Trends-onderzoek van PageGroup onder zo’n 50.000 respondenten wereldwijd, van wie zo’n 1.000 in Nederland. ‘Teleurstellend’, aldus managing director Joost Fortuin. ‘Met de huidige krapte is het doodzonde dat een potentieel van zo’n 260.000 goed gemotiveerde arbeidskrachten onvoldoende wordt aangesproken. Het is aan alle betrokkenen om hier een einde aan te maken. De regelgeving is duidelijk, nu is het tijd dat we ons allemaal ernaar gaan gedragen.’

Toch is er ook wel een beweging die kant op waar te nemen. Zo was er op LinkedIn in mei 2024 een levendige discussie over een nieuwe McDonald’s-campagne, specifiek gericht op ouderen. En pleitte niet veel daarvoor Radboud-econoom en Volkskrant-columniste Kim Fairley nog voor een meer open blik richting de graag langer doorwerkende ouderen. Die open blik moet daarbij vooral van recruiters komen, stelt ze, en niet van subsidies. Uit een recente studie blijken die subsidies namelijk juist nadelig uit te pakken voor oudere kandidaten: ze geven recruiters het signaal af dat er dan dus wel iets met hen mis zal zijn.

#5. Uitzendkrachten risico bij ondermijning?

Hoe belangrijk is screening van nieuwe medewerkers? En gebeurt het wel genoeg? Het zijn steeds relevantere vragen, nu bijvoorbeeld blijkt dat de risico’s van corruptie en criminele ondermijning bij de fiscus groot zijn, en met name uitzendkrachten daarbij genoemd worden. Zo stromen bij de Belastingtelefoon jaarlijks zo’n 1.500 nieuwe medewerkers in die toegang hebben tot gevoelige persoonsgegevens, maar voor wie de screening in handen ligt van uitzendbureaus. Dat leidt soms tot wat onderzoekers ‘parachuteren’ noemen: medewerkers die als zetbaas voor criminele organisaties werkten.

‘Parachuteren’ criminele organisaties tijdelijke medewerkers bij cruciale organisaties?

Ook op Schiphol bleek in mei 2024 overigens dergelijke ondermijning voor te komen: een luchthavenmedewerker werd gearresteerd, op verdenking van betrokkenheid bij grootschalige internationale drugshandel. Iets wat ook hier in de hand wordt gewerkt door bijvoorbeeld de lage lonen op de luchthaven, de vele tijdelijke contracten en de magere binding met de werkgever, aldus vakbond FNV.

#6. Morele ambitie wordt kans

Voor zijn pleidooi voor morele ambitie kreeg Rutger Bregman nogal eens de kritiek dat het allemaal wat gratuit was, dat oproepen van de elite om nu ook eens goede dingen voor de mensheid te gaan doen. Want waarom zette hij dat zelf niet wat meer in daden om? Welnu, dat is ook gebeurd. Vanaf 1 mei 2024 startte de zogeheten School for Moral Ambition namelijk met een fellowship, waarmee je – als je dat wilt – kunt gaan werken aan enkele grote wereldproblemen, zoals het bestrijden van de tabaksindustrie, of het versnellen van de zogeheten eiwittransitie.

Voor zijn pleidooi voor morele ambitie kreeg Rutger Bregman nogal eens de kritiek dat het allemaal wat gratuit was, dat oproepen van de elite om nu ook eens goede dingen voor de mensheid te gaan doen. Want waarom zette hij dat zelf niet wat meer in daden om? Welnu, dat is ook gebeurd. Vanaf 1 mei 2024 startte de zogeheten School for Moral Ambition namelijk met een fellowship, waarmee je – als je dat wilt – kunt gaan werken aan enkele grote wereldproblemen, zoals het bestrijden van de tabaksindustrie, of het versnellen van de zogeheten eiwittransitie.

‘Het belangrijkste is dat je het idealisme van een activist combineert met de ambitie van een ondernemer.’

Met billboards rond de Zuidas probeerde Bregman afgelopen maand mensen aan te trekken om hun morele ambitie vorm te geven. Word je geselecteerd als een van de 24 fellows, dan zeg je je huidige baan op en begin je 1 september aan een intensief trainingsprogramma, waar onder meer 6 maanden praktijkervaring inzit bij een partnerorganisatie in Brussel, Berlijn of Genève. ‘Het belangrijkste is dat je het idealisme van een activist combineert met de ambitie van een ondernemer’, aldus Bregman over de selectiecriteria voor deze mogelijke carrièrestap, waar een ‘stipendium‘ van maximaal 3.600 euro per maand (bruto) tegenover staat.

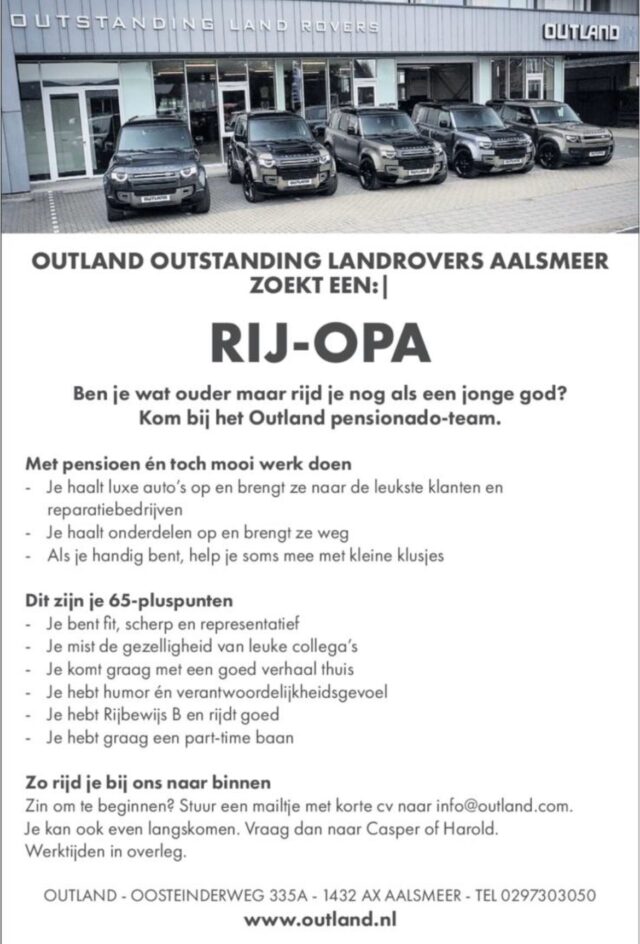

#7. Wollig taalgebruik? Niet bij de rij-opa’s!

Vacatureteksten? Ze zijn een noodzakelijk kwaad, maar ook nog altijd om te huilen. Zo vindt bijna 6 op de 10 sollicitanten vacatureteksten ‘te lang’, en 4 op de 10 dat het taalgebruik erin onnodig moeilijk is, aldus onderzoek van Intermediair en NationaleVacaturebank dat in mei 2024 verscheen. ‘Onbegrijpelijk’, noemt directeur Sharita Boon het dat bedrijven dat nog steeds niet beter onder de knie hebben. ‘Gebruik je vaktaal, wollig taalgebruik of is je tekst onnodig lang? Dan sluit je een hele grote groep potentiële sollicitanten uit. Op de huidige arbeidsmarkt kun je je dat simpelweg niet veroorloven.’

Hoe het ook kan? Daarvan was deze maand een fraai staaltje te zien bij copywriter Martijn de Vreeze, die voor een ‘lokaal sufferdje’ een veelbesproken vacature voor een ‘Rij-opa’ maakte. Leeftijdsdiscriminatie? Wettelijk verboden? Misschien zelfs een tikkeltje beledigend? Vast wel. Maar de vacature leidde wel mooi in 3 dagen tot 50 aanmeldingen én 20 spontane bezoekjes bij Outland in Aalsmeer. En tot meer dan 100.000 kliks op de pagina van De Vreeze, die daarover zelf stelt: ‘Er is zoveel bij wet verboden. Leuke teksten gelukkig niet. En zo moet je dit zien.’

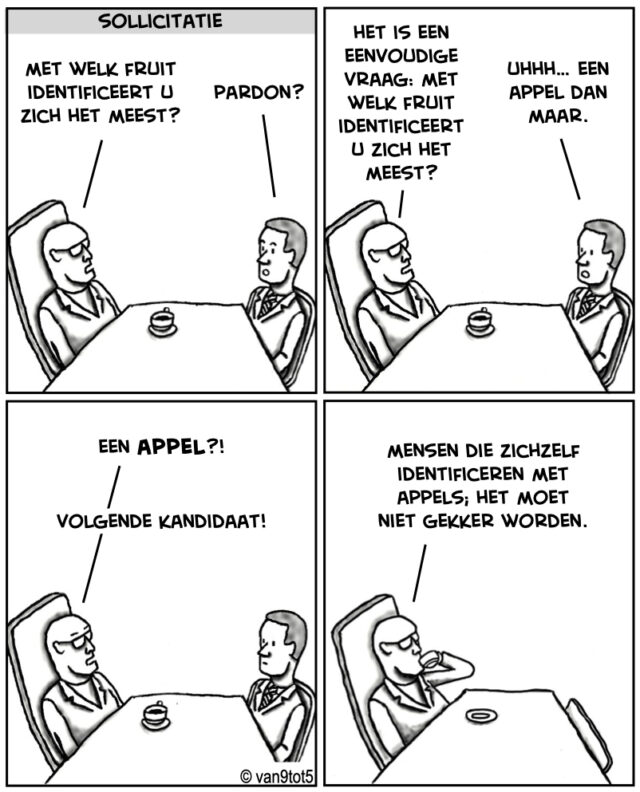

#8. Cartoon van de maand

Bron: van9tot5

Iets over het hoofd gezien?

In de rubriek ‘De maand in werving’ belichten we trends en ontwikkelingen voor iedereen in de wereld van recruitment. In mei 2024 iets belangrijks over het hoofd gezien? Meld het ons!

Beluister de podcast

Liever luisteren? Martijn Hemminga en Peter Boerman maken ook (bijna) elke maand een podcast over dit nieuwsoverzicht. Beluister hier de meest recente opname:

Lees ook

- De maand in werving: 7 dingen die ons opvielen in april 2024

- De maand in werving: 7 dingen die ons opvielen in maart 2024

- 7 dingen die ons opvielen in februari 2024

- 7 dingen die ons opvielen in januari 2024

- De dingen die ons opvielen in december 2023

- De dingen die ons opvielen in november 2023

- Alle maandoverzichten

Wim van den Nobelen is recruiter, investeerder, ambassadeur voor

Wim van den Nobelen is recruiter, investeerder, ambassadeur voor