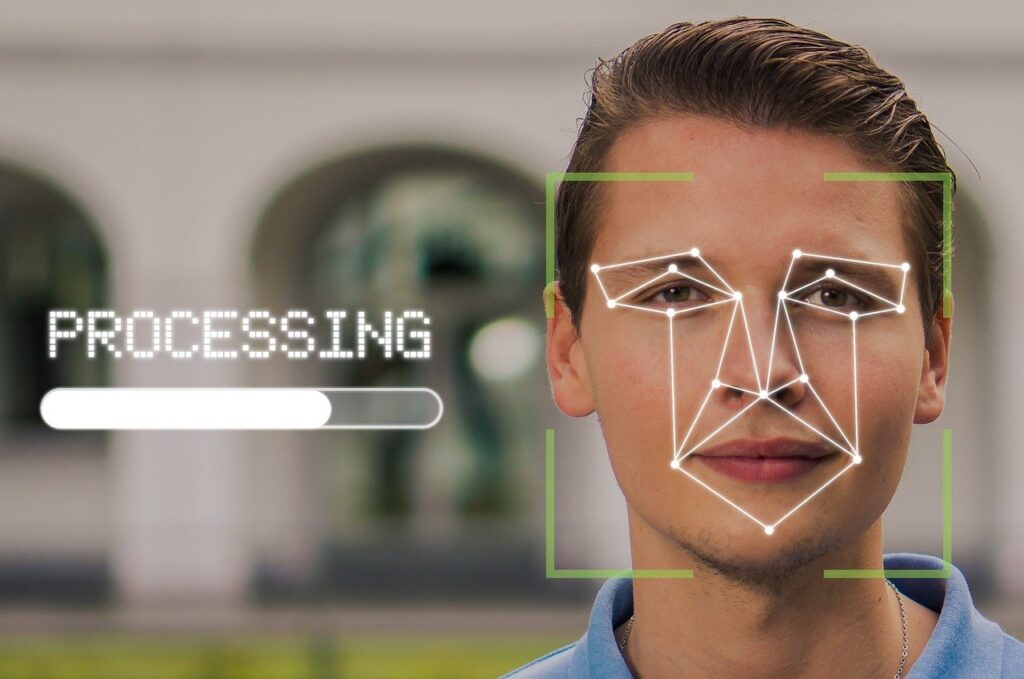

Van het ontgrendelen van je telefoon tot geautomatiseerde paspoortgrenscontrole: software voor gezichtsherkenning is in opkomst. Maar voor werving en selectie lijkt het allemaal toch wat minder makkelijk geschikt. Tenminste, HireVue, een van de pioniers op dit terrein, ligt zwaar onder vuur vanwege de software die het tot 2021 gebruikte om persoonlijkheidsprofielen aan de hand van gezichten af te lezen.

HireVue, een van de pioniers op dit terrein, ligt zwaar onder vuur.

Wat is er gebeurd? Op 27 januari 2022 diende de Amerikaanse Kristen Deyerler, die in 2019 naar een baan solliciteerde, in Illinois een class action–klacht in tegen HireVue, wegens vermeende schendingen van de BIPA (Biometrische Informatie Privacy Act). Het was ook deze staat die in 2019 als eerste het gebruik van algoritmes en andere vormen van A.I. om sollicitanten te analyseren tijdens video-interviews reguleerde. Dat gebeurde destijds met de invoering van de Artificial Intelligence Video Interview Act (AIVI).

Drieledige klacht

De klager beweert dat HireVue geen openbaar beschikbaar bewaarschema en/of richtlijnen heeft verstrekt voor het permanent vernietigen van de biometrische gegevens. Terwijl dat wel zou moeten. Ze beweert ook dat het bedrijf illegaal gezichtsgegevens verzamelde voor analyse, zonder schriftelijke toestemming, toen ze via het online platform van HireVue een sollicitatiegesprek voerde. En ze beschuldigt het bedrijf ook te profiteren van de biometrische gezichtsherkenningstekens van haar en anderen.

Koren op de molen van Chad Sowash, co-host van de Chad and Cheese-podcast, die de zaak onlangs becommentarieerde, onder de noemer Pretty Bias Machine. ‘Ik vind dit volkomen weerzinwekkend om te denken dat een algoritme het hele menselijke ras zou kunnen standaardiseren door middel van gezichtsbewegingen’, zei hij. ‘Dit is voor mij een ultieme bias-machine. De federale overheid moet echt tussenbeide komen. Want als je geen inwoner van Illinois bent, geloof ik niet dat je daadwerkelijk aan deze rechtszaak kunt deelnemen.’

‘Geen enkel bedrijf zal zulke diensten nog willen gebruiken als dit soort rechtszaken dreigen.’

Mede-presentator Joel Cheesman ging met hem mee in dat idee. ‘Gezichtsherkenning en het analyseren van gezichtsreacties in het wervingsproces is nu officieel dood voor mij’, zei hij. ‘Wat er ook gebeurt met deze zaak, die waarschijnlijk buiten de rechtbank zal worden geregeld, meer staten gaan wetten invoeren zoals Illinois. Als het geen federale wetgeving is. Geen enkele leverancier zal dit nog willen en geen enkel bedrijf zal zulke diensten nog willen gebruiken als dit soort rechtszaken voor hen dreigen.’

Pseudowetenschap?

Het kan zelfs gaan om ‘pseudowetenschap’, zegt Meredith Whittaker, medeoprichter en mededirecteur van het AI Now Institute aan de New York University en senior adviseur van de Federal Trade Commission on A.I. Door de jaren heen heeft Whittaker vaak betoogd dat gezichtsanalyses misschien beweren elementen als ‘persoonlijkheid’ en ‘werknemersbetrokkenheid’ te meten, maar dat ze daarin niet worden ondersteund door robuust wetenschappelijk bewijs.

‘De technologie weerspiegelt in diskrediet gebrachte praktijken uit het verleden.’

‘De bewering dat het mogelijk is om de innerlijke kenmerken van een persoon te bepalen op basis van hun gezichtsuitdrukking door middel van affectherkenning, wordt niet ondersteund door wetenschappelijke consensus’, schreef ze bijvoorbeeld in 2020. ‘De technologie weerspiegelt in diskrediet gebrachte pseudowetenschappelijke praktijken uit het verleden, waaronder fysionomie, frenologie en rassenleer. Die allemaal fysieke verschillen tussen mensen interpreteerden als tekenen van hun innerlijke waarde en dit gebruikten om sociale ongelijkheid te rechtvaardigen.’

Ze waren er zelf ook al achter…

HireVue was er zelf trouwens ook al eerder achtergekomen hoe gevoelig de software voor gezichtsherkenning lag. Niet voor niets meldde het bedrijf in januari vorig jaar aan dat het zou stoppen met de component gezichtsanalyse uit zijn screeningbeoordelingen, vanwege ‘de toenemende bezorgdheid over het transparante en juiste gebruik van kunstmatige intelligentie bij selectiebeslissingen’. Volgens het in Salt Lake City gevestigde bedrijf zou de kracht van taalanalyse voldoende zijn, en zou ‘visuele analyse geen significante meerwaarde meer voor de beoordelingen’ toevoegen.

Volgens HireVue zou ‘visuele analyse geen significante meerwaarde meer voor de beoordelingen’ toevoegen.

Tot die tijd had het HireVue-platform al bijna 20 miljoen video-interviews gehost voor meer dan 700 klanten wereldwijd. Daaronder grote namen als Unilever en Vodafone. De Hirevue-software is bedoeld om de intrinsieke bias van individuele menselijke interviewers bij de beoordeling van kandidaten te verminderen. ‘Maar in de loop der tijd droegen de visuele componenten minder bij aan de beoordeling, tot het punt waarop er zoveel publieke bezorgdheid was over alles wat te maken had met A.I., dat het de bezorgdheid die het veroorzaakte niet waard was’, aldus HireVue-CEO en voorzitter Kevin Parker destijds.

Soms wel een verband

Ook al was er in bepaalde klantgerichte rollen een verband tussen bewegingen van de gezichtsspieren en werkprestaties – waarbij glimlachen bijvoorbeeld belangrijk kan zijn – meestal was die informatie niet nodig, vulde head of data science Lindsey Zuloaga toe. ‘Ons onderzoek toont aan dat wat mensen zeggen en wat hun gezicht doet vaak nauw op elkaar aansluiten.’ Waarbij ze eraan toevoegde dat kandidaten ‘nooit werden beoordeeld op basis van gevoelige of persoonlijke visuele kenmerken.’

‘Ons onderzoek toont aan dat wat mensen zeggen en wat hun gezicht doet vaak nauw op elkaar aansluiten.’

Toch waren destijds velen blij met het HireVue-besluit. ‘Gezichtsanalyse is nooit een onafhankelijk en wetenschappelijk gevalideerde voorspeller geweest van iemands bekwaamheid, capaciteit of succes in een rol’, zei toen bijvoorbeeld Merve Hickok, docent en spreker over A.I.-ethiek en oprichter van Lighthouse Career Consulting. ‘Gezichtsuitdrukkingen zijn niet universeel – ze kunnen veranderen door cultuur, context en handicaps – en ze kunnen ook worden gespeeld. Dus, nauwkeurigheid bij het correct categoriseren van een uitdrukking is sowieso al problematisch. Laat staan om er eigenschappen uit af te leiden.’

Signaalfuncties

‘We moeten bij screening niet vertrouwen op signaalfuncties die niets te maken hebben met werkprestaties’, voegde Julia Stoyanovich, assistent-professor computerwetenschappen aan de Tandon School of Engineering van de New York University toe. Maar dat is ook precies wat HireVue probeert te voorkomen, benadrukt Zuloaga. ‘Het klopt niet dat we je alleen maar zien praten en de manier waarop je praat ons vertelt wie je bent. Zo wordt het soms afgeschilderd. Maar het zou een afschuwelijk model zijn als het waar was. Dat is dan ook niet wat we doen.’

‘Het klopt niet dat we je alleen maar zien praten en de manier waarop je praat ons vertelt wie je bent.’

En dus ook steeds minder gebeurt. Stoyanovich sluit dan ook positief af. Ze is het ermee eens dat teruggaan naar het handmatig screenen van sollicitaties ‘belachelijk’ zou zijn. Ze voegde eraan toe dat ‘algoritmen bij de werving en selectie van talent ons kunnen helpen om processen verantwoordelijk te houden en mensen aan te nemen in overeenstemming met de doelen die we hebben geformuleerd. Maar we moeten niet overschatten of te veel beloven wat ze kunnen doen.’